Los límites de uso de Claude no solo dependen del plan contratado. También dependen, y mucho, de cómo se trabaja con la herramienta. Muchos usuarios llegan al aviso de límite después de varias horas de programación, redacción, análisis de documentos o creación de prototipos, y suelen pensar que la única salida es pagar más. A veces será necesario, pero en muchos casos el problema está en el flujo de trabajo: conversaciones demasiado largas, prompts poco precisos, uso del modelo más potente para tareas simples y peticiones que obligan a rehacer lo mismo varias veces.

Trabajar con inteligencia artificial generativa exige una disciplina parecida a la que ya aplican las empresas al cloud, las APIs o el almacenamiento. Cada interacción consume recursos. En el caso de los modelos de lenguaje, esos recursos se miden en tokens, que representan fragmentos de texto de entrada, salida y contexto. Cuanto más larga sea la conversación, más grande sea el documento, más complejo sea el código o más vueltas se pidan al modelo, mayor será el consumo.

La buena noticia es que se puede ahorrar mucho sin trabajar peor. De hecho, el ahorro suele venir acompañado de mejores resultados. Planificar antes de ejecutar, dividir bien las tareas y elegir el modelo adecuado permite reducir reconstrucciones, acortar respuestas innecesarias y evitar sesiones interminables que acaban consumiendo cuota y bajando la calidad del resultado.

El primer ahorro empieza antes del primer prompt

Uno de los errores más habituales consiste en abrir Claude y pedirle directamente que «haga algo» sin haber definido bien el objetivo. «Hazme una app», «mejora este texto», «arregla este código» o «prepara una estrategia» son instrucciones válidas para empezar una conversación, pero no siempre son eficientes. El modelo tendrá que adivinar requisitos, tomar decisiones por su cuenta y corregir después el rumbo con nuevas respuestas.

Ese método parece rápido, pero suele salir caro. Cuando una tarea compleja se construye sin planificación, el resultado inicial rara vez encaja del todo. Después llegan las correcciones, los cambios de estructura, los «mejor así no», las reescrituras completas y, en programación, los refactors que podrían haberse evitado con una especificación mínima.

Una forma más eficiente de trabajar es separar claramente la fase de planificación de la fase de ejecución. En la primera, se pide al modelo que haga preguntas, ordene requisitos, detecte riesgos y proponga una estructura. En la segunda, ya con las decisiones aprobadas, se le pide que redacte, programe, revise o construya.

Forma de trabajar |

Qué suele pasar |

Consumo de tokens |

Resultado |

Ejecutar sin plan |

El modelo improvisa y hay que rehacer |

Alto |

Irregular |

Planificar poco |

Se evitan algunos errores, pero quedan huecos |

Medio |

Aceptable |

Planificar bien |

El modelo ejecuta con menos dudas |

Más bajo |

Más sólido |

Planificar con un modelo ligero y ejecutar con uno potente |

Se reserva el gasto caro para lo importante |

Más eficiente |

Mejor equilibrio |

Esta diferencia se nota mucho en tareas de programación. Un agente que tiene que explorar un repositorio, leer archivos, modificar código, ejecutar pruebas y corregir errores puede consumir muchos tokens en cada ciclo. Si el objetivo no está claro, esos ciclos se multiplican. Un plan previo reduce el número de intentos.

No todas las tareas necesitan el modelo más potente

Otro hábito caro es usar siempre el modelo más avanzado. Es comprensible: si se paga por una herramienta potente, lo lógico parece utilizarla para todo. Pero no todas las tareas requieren el mismo nivel de razonamiento. Lluvias de ideas, esquemas, resúmenes simples, clasificación de notas o primeras versiones pueden hacerse con modelos más ligeros o intermedios.

Los modelos más capaces deberían reservarse para las tareas donde realmente aportan valor: depuración compleja, generación de código delicado, revisión final, análisis de documentos largos, decisiones con muchas restricciones o trabajos que requieren mayor precisión.

Tarea |

Modelo recomendado |

Motivo |

Lluvia de ideas | Ligero | Barato y suficiente para explorar opciones |

Esquema inicial | Ligero o intermedio | Lo importante es ordenar, no pulir |

Resumen simple | Ligero | No suele requerir razonamiento profundo |

Primer borrador | Intermedio | Buen equilibrio entre calidad y coste |

Código complejo | Intermedio o avanzado | Depende del tamaño y dificultad |

Depuración difícil | Avanzado | Puede ahorrar intentos fallidos |

Revisión final | Avanzado | Aporta criterio cuando el trabajo ya está definido |

Análisis de repositorio | Avanzado, pero con alcance limitado | Consume mucho contexto y debe usarse con control |

La clave es trabajar por escalones. Primero se explora con una opción más barata. Después se sube de nivel cuando la tarea lo justifica. Es un cambio pequeño, pero para usuarios intensivos puede marcar una diferencia enorme.

Los chats largos son cómodos, pero caros

Las conversaciones largas parecen útiles porque conservan contexto. El problema es que no todo el contexto antiguo sigue siendo útil. En un chat de muchas horas pueden quedar ideas descartadas, instrucciones que ya no aplican, versiones anteriores, errores corregidos y decisiones contradictorias. El modelo tiene que procesar parte de ese historial y eso aumenta el consumo.

Además, un contexto demasiado cargado puede empeorar la respuesta. El modelo puede dar importancia a información antigua o mezclar indicaciones de fases distintas. Por eso, en trabajos repetitivos o largos, conviene usar proyectos con instrucciones estables y chats separados para cada tarea.

Un proyecto puede contener las reglas generales: tono, formato, estilo, restricciones, información del negocio o preferencias del usuario. Después, cada tarea concreta se abre en un chat nuevo. Así se mantiene lo importante sin arrastrar todo el historial.

Problema del chat largo |

Solución práctica |

Demasiado contexto antiguo | Abrir un nuevo chat con un resumen |

Instrucciones mezcladas | Usar proyectos con reglas estables |

Respuestas cada vez más lentas | Dividir la tarea en conversaciones cortas |

Repetición de preferencias | Guardar instrucciones reutilizables |

Pérdida de foco | Separar cada objetivo en un chat distinto |

Una técnica muy útil es pedir un prompt de traspaso. Cuando una conversación se vuelve demasiado larga, se puede pedir: «Resume esta sesión para continuar en un nuevo chat. Incluye solo el objetivo actual, decisiones aprobadas, restricciones, archivos importantes y próximos pasos. Elimina ideas descartadas». Ese resumen se pega en una conversación nueva y permite seguir con menos ruido.

Cómo planificar para ahorrar tokens

Planificar no significa escribir documentos eternos antes de cada tarea. Significa dedicar unos minutos a evitar errores caros. Para una tarea sencilla, basta con una lista de requisitos. Para un proyecto de código, conviene definir alcance, estructura, dependencias, criterios de éxito y límites. Para un artículo, tema, enfoque, público, extensión, tono y fuentes disponibles.

Paso |

Objetivo |

Ejemplo de prompt |

Definir objetivo | Aclarar qué se quiere conseguir | «Antes de escribir, resume el objetivo y pregúntame lo que falte.» |

Cerrar requisitos | Evitar suposiciones | «Crea una lista de requisitos y espera mi aprobación.» |

Delimitar alcance | Impedir que añada extras | «No añadas funciones no solicitadas.» |

Elegir estructura | Reducir cambios posteriores | «Propón una estructura antes de redactar.» |

Ejecutar | Construir sobre lo aprobado | «Ahora desarrolla solo la versión aprobada.» |

Revisar | Corregir sin reescribir todo | «Detecta problemas críticos, pero no rehagas el texto completo.» |

Traspasar | Empezar limpio si el chat crece | «Crea un prompt para continuar en un nuevo chat.» |

Este método evita una de las mayores fuentes de gasto: pedir una salida larga demasiado pronto. Es mejor pedir primero un esquema, revisar el enfoque y después desarrollar. Si el esquema está mal, corregirlo cuesta poco. Si el artículo completo, el código o la presentación ya están generados, corregirlo cuesta mucho más.

Ejemplos de prompts más eficientes

Los prompts eficientes no tienen por qué ser largos, pero sí deben ser concretos. La diferencia entre una instrucción vaga y una buena instrucción suele estar en el alcance.

Prompt poco eficiente |

Prompt más eficiente |

«Hazme una app de finanzas.» | «Ayúdame a planificar una app de finanzas personales. No escribas código todavía. Pregunta por usuarios, funciones, datos, seguridad y pantallas.» |

«Mejora este texto.» | «Mejora este texto para un medio generalista, mantén el tono claro, no cambies los datos y reduce repeticiones.» |

«Arregla este código.» | «Analiza este error, identifica la causa probable y propón un cambio mínimo. No reescribas todo el archivo.» |

«Escribe un artículo sobre IA.» | «Propón primero una estructura para un artículo de 900 palabras sobre ahorro de tokens en herramientas de IA, con enfoque práctico para profesionales.» |

El objetivo es que el modelo no tenga que adivinar. Cada suposición que se evita reduce el riesgo de una salida equivocada.

Memoria reutilizable: menos repeticiones, menos consumo

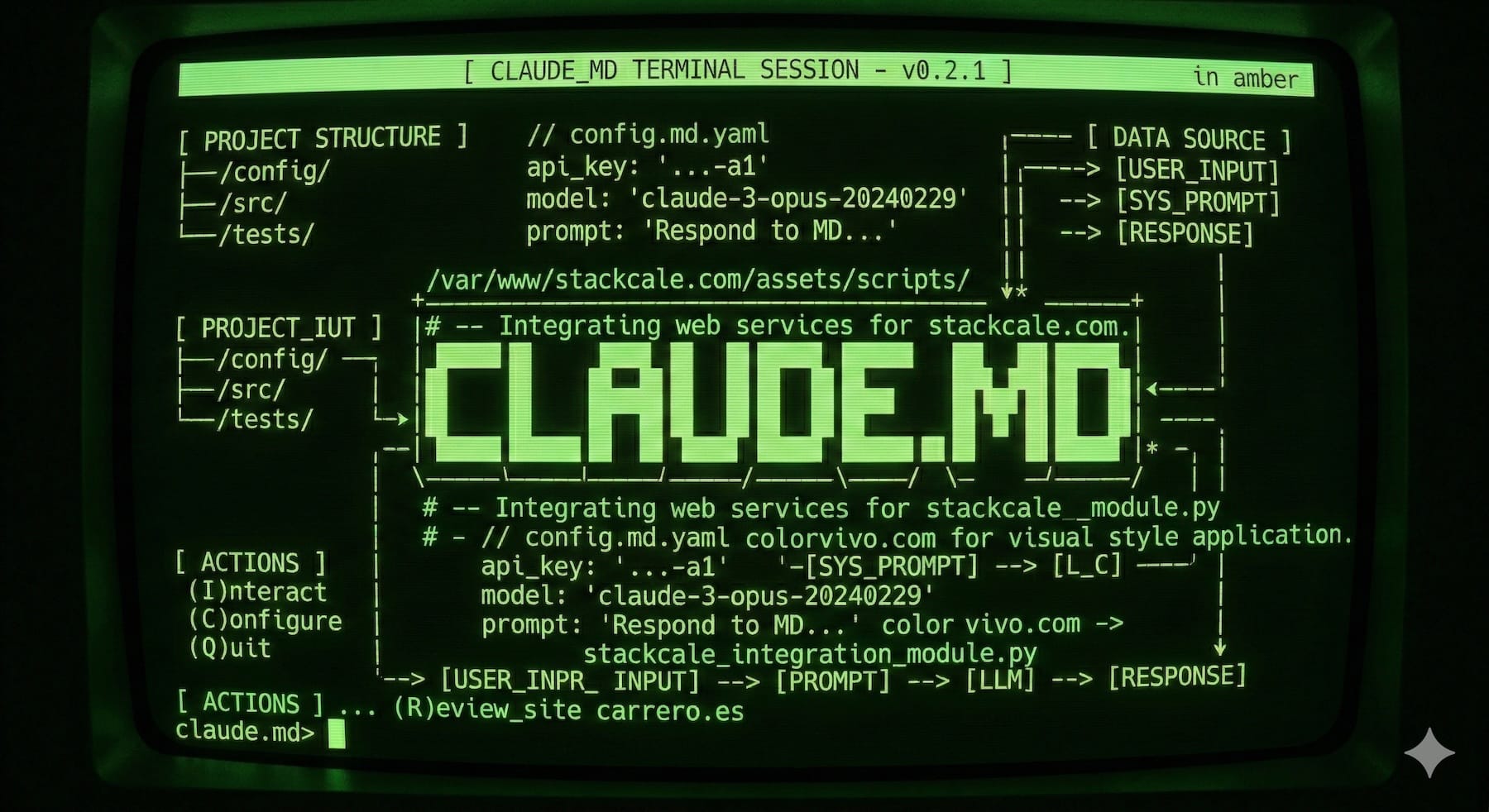

Otra forma de ahorrar tokens es no repetir siempre las mismas preferencias. En herramientas con acceso a archivos, una solución sencilla consiste en crear dos documentos Markdown: uno de instrucciones y otro de memoria.

Instructions.md puede incluir reglas permanentes: quién es el usuario, qué tipo de trabajo hace, tono preferido, formato de salida, palabras que debe evitar y criterios de calidad. Memory.md puede guardar preferencias que aparecen con el uso: correcciones frecuentes, patrones de estilo, decisiones de proyecto o recordatorios.

Archivo |

Función |

Instructions.md | Reglas permanentes de trabajo |

Memory.md | Preferencias y correcciones que evolucionan |

Una instrucción útil dentro de Instructions.md sería: «Actualiza Memory.md cuando te dé una preferencia duradera o una corrección recurrente». Así, si el usuario pide no usar determinadas expresiones, reducir la longitud de las respuestas o mantener un estilo concreto, esa preferencia queda guardada y no hace falta repetirla en cada conversación.

Ajustes pequeños que también ayudan

El ahorro no depende solo de grandes cambios. También hay pequeños hábitos que reducen consumo.

Ajuste |

Cuándo usarlo |

Ventaja |

Respuestas concisas | En tareas diarias | Menos tokens de salida |

Modo planificación | Antes de construir o programar | Menos reconstrucciones |

Esfuerzo bajo | En cambios simples | Evita razonamiento excesivo |

Chats nuevos por tarea | En trabajos largos | Contexto más limpio |

Revisión de uso | En sesiones intensivas | Evita sorpresas |

Modelos alternativos | Para tareas simples | Reduce coste de modelos premium |

Instrucciones de proyecto | En trabajos repetitivos | Evita explicar siempre lo mismo |

También conviene evitar que el modelo reescriba por completo cuando solo se necesita una corrección parcial. En lugar de pedir «rehazlo», es mejor indicar qué sección, función o párrafo debe tocar.

La nueva alfabetización de la IA incluye saber gastar tokens

Durante mucho tiempo, usar IA parecía tan simple como escribir una pregunta y esperar una respuesta. Para un uso ocasional, puede bastar. Para un uso profesional, no. Quien trabaja a diario con modelos de lenguaje necesita aprender a gestionar contexto, costes, modelos, instrucciones y memoria.

Ahorrar tokens no consiste en limitar la creatividad ni en pedir menos ayuda. Consiste en pedir mejor. Una sesión bien planificada puede generar mejores resultados, consumir menos cuota y evitar la frustración de quedarse bloqueado a mitad de una tarea importante.

La inteligencia artificial no será infinita ni gratuita para los usuarios intensivos. Los modelos avanzados, los agentes de código, el análisis de grandes documentos y el razonamiento con mucho contexto tienen un coste real. Por eso, aprender a trabajar con ellos de forma ordenada se está convirtiendo en una habilidad profesional.

El futuro no será de quien más prompts lance, sino de quien mejor sepa estructurar el trabajo. En Claude, como en cualquier herramienta potente, la productividad no depende solo del modelo. También depende del método.

Preguntas frecuentes

¿Por qué se agotan tan rápido los límites de Claude?

Por conversaciones largas, tareas de código, grandes contextos, reconstrucciones repetidas y uso de modelos avanzados para tareas que podría resolver uno más ligero.

¿Planificar antes de pedir una tarea ahorra tokens?

Sí. Una buena planificación reduce errores, evita reconstrucciones y permite que el modelo ejecute con menos dudas.

¿Conviene abrir chats nuevos con frecuencia?

En tareas largas, sí. Un chat nuevo con un resumen limpio suele ser más eficiente que una conversación interminable llena de contexto antiguo.

¿Es mejor usar siempre el modelo más potente?

No. Lo más eficiente es reservarlo para tareas difíciles y usar modelos ligeros o intermedios para ideación, esquemas y trabajo preliminar.